米国政府が「安全性の旗手」Anthropicを調達禁止にした危機対応から学ぶ広報戦略

US Government Bans 'Safety-First' AI Company, A Crisis Response Case Study

ポイント

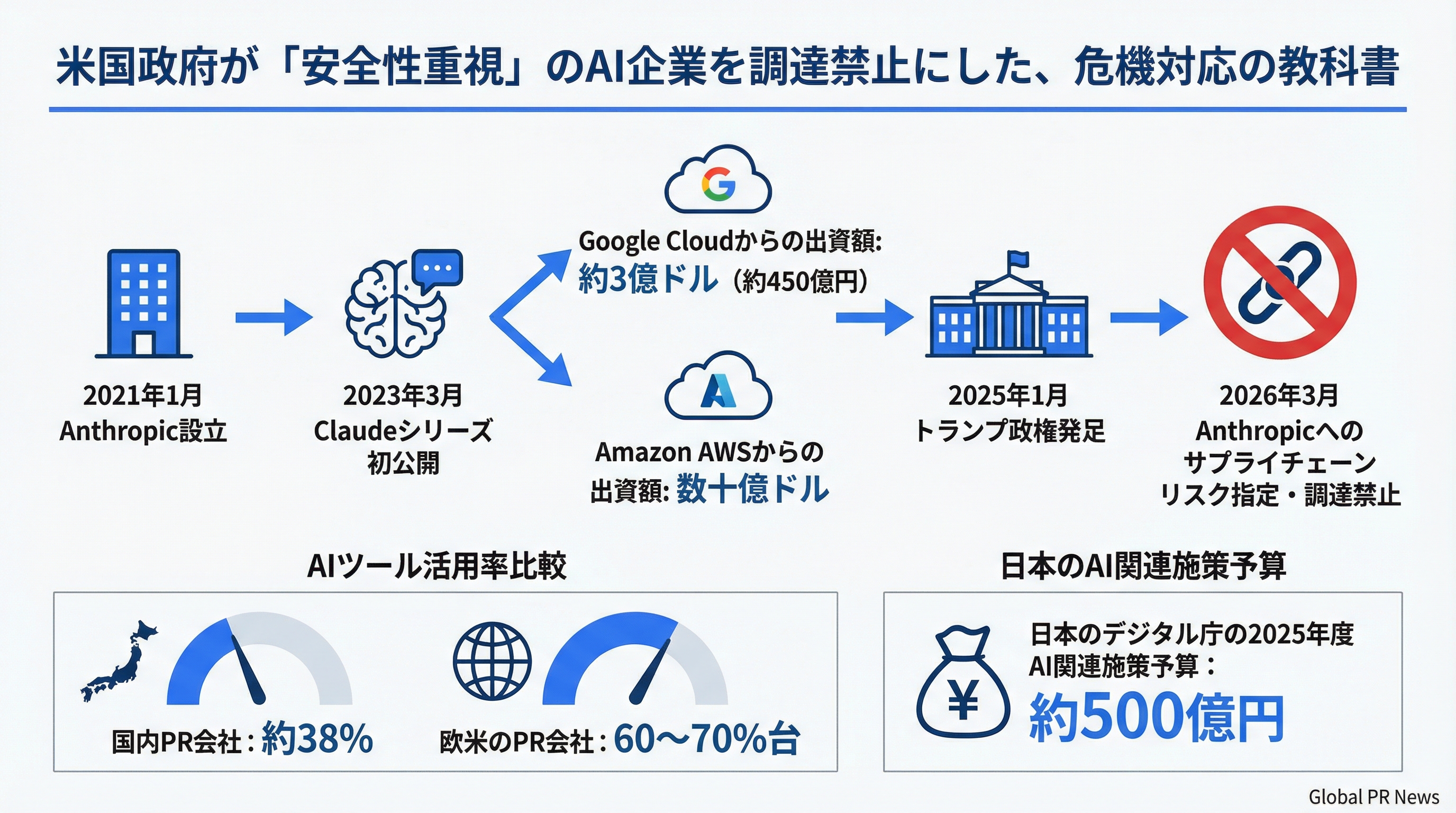

- 2026年3月、米政府は安全性重視のAI企業Anthropicの調達を禁止した

- 「サプライチェーンリスク」指定の理由はAI軍事利用の方針相違だ

- Anthropicは冷静に対応も、ブランドとビジネスに深刻な打撃

米国シカゴを拠点とするPR・コミュニケーション専門メディア「PR Daily」は、米国のAI企業Anthropic(アンソロピック)がトランプ政権による調達禁止措置を受け、冷静かつ安心感を重視したトーンで公式対応を行ったと2026年3月2日公開の記事で報じた。

「安全性の旗手」が突然の禁止令を受けた経緯

Anthropicは2021年1月、米国のAI企業OpenAIの安全性・倫理方針に異議を唱えた研究者チームによって設立されたAI企業だ。創業者はCEOのダリオ・アモデイ氏と、社長を務める姉妹のダニエラ・アモデイ氏で、いずれもOpenAI出身である。同社は「Constitutional AI(憲法的AI)」と呼ばれる独自手法を採用しており、人間の価値観や倫理観をAIの「憲法」として訓練段階で埋め込むことで、有害なコンテンツの生成を抑制する設計が特徴だという。公益法人(Public Benefit Corporation)として利益と社会的使命の両立を掲げており、GoogleのクラウドコンピューティングサービスGoogle Cloudから約3億ドル(約450億円 ※1ドル150円換算)の出資を受け、米国大手テクノロジー企業Amazonのクラウド基盤AWS(Amazon Web Services)を通じても数十億ドル規模の出資を受けている。

同社の主力製品は大規模言語モデル(LLM)の「Claude(クロード)」シリーズで、2023年3月に初公開された。企業・規制業界向けの信頼性の高いAIとして評価されており、安全性を重視するその設計思想は、政府機関や金融・医療分野での採用を後押ししてきた。

トランプ政権が下した「サプライチェーンリスク」指定

PR Dailyの報道によると、2025年1月に発足したトランプ政権(米国第47代大統領ドナルド・トランプ率いる連邦政府)は2026年3月時点、連邦政府機関に対してAnthropicのAI技術の使用停止を命じ、同社を「サプライチェーンリスク」として指定したという。この決定の引き金となったのは、AIの軍事利用に関する方針の相違だとされている。

「サプライチェーンリスク」とは、政府調達において特定のサプライヤーや製品を国家安全保障上の懸念から排除する枠組みを指す。かつて米国政府が中国の通信大手ファーウェイを同様の枠組みで締め出したことで知られる指定であり、AI企業への適用は前例のない事態だとPR Dailyは伝えている。

安全性・倫理性の高さを企業価値の核心に据えてきたAnthropicにとって、「リスク」のレッテルを政府から貼られるという事態は、ブランド上の深刻な矛盾をはらむ。同社にとって政府機関は重要な顧客基盤の一つであり、今回の措置はビジネス上の打撃にとどまらず、「最も安全なAI企業」という評判そのものへの挑戦ともなった。

「冷静・安心」路線の危機対応が注目を集める

こうした局面でAnthropicが選択したのは、過度な防衛姿勢を取らず、冷静さと安心感を前面に出す広報対応だったとPR Dailyは報じている。CEOのダリオ・アモデイ氏が主導するかたちで、感情的な反論や政府批判を避けながら、ステークホルダーの信頼維持を優先するトーンのコミュニケーションを行ったという。

PR Dailyはこの対応をケーススタディとして取り上げ、政府機関との関係において政治リスクが顕在化した際、AI企業がいかにブランド戦略と危機対応を統合すべきかという問いを業界に投げかけている。政府調達・防衛分野でのAI活用を目指す企業にとって、「政府指定リスク」という新たなレピュテーション上のリスク類型が現実のものとなったことを示す事例だとしている。また、GoogleおよびAmazonという巨大テクノロジー企業2社を主要投資家に持つ同社が今回の指定を受けたことは、出資関係や企業規模がそのままレピュテーションリスクの回避につながらないことをあらためて示していると、PR Dailyは指摘している。

情報ソース一覧

- The Scoop: Anthropicが「サプライチェーンリスク」の決定に冷静かつ安心感を持って対応 - PR Daily The Scoop: Anthropic responds to ‘supply chain risk’ decision with calm, reassurance - PR Daily www.prdaily.com

- レポート: Anthropicの事業内訳と創業ストーリー | Contrary Research Report: Anthropic Business Breakdown & Founding Story | Contrary Research research.contrary.com/company/anthropic

- Anthropicの物語 | magicdoor.ai The story of Anthropic | magicdoor.ai www.magicdoor.ai/resources/anthropic-models/anthropic-history

- Anthropicとは? | Built In What Is Anthropic? | Built In builtin.com/articles/anthropic

- MicroVenturesのポートフォリオ企業: Anthropicの歴史とマイルストーン MicroVentures’ Portfolio Company: Anthropic’s History and Milestones microventures.com

- Anthropicとは? Claude AIとClaude Codeの歴史 (2026) What is Anthropic? History of Claude AI & Claude Code (2026) www.taskade.com/blog/anthropic-claude-history

- Anthropic PBCについて:スタートアップ All About Anthropic PBC: the Startup apix-drive.com/en/blog/useful/anthropic-pbc-history-development-products

- 企業情報 \ Anthropic Company \ Anthropic www.anthropic.com/company