AIエージェントの「信頼性」は精度の7分の1の速さでしか改善しないとプリンストン大学が警告

AI accuracy up, but reliability lags: Princeton releases first multi-dimensional evaluation

ポイント

- プリンストン大学はAI信頼性の多次元評価を公開した

- 最先端AIの精度は高いが信頼性向上が精度の7分の1に留まる

- トップモデルでも安全性で25%の壊滅的エラーが報告された

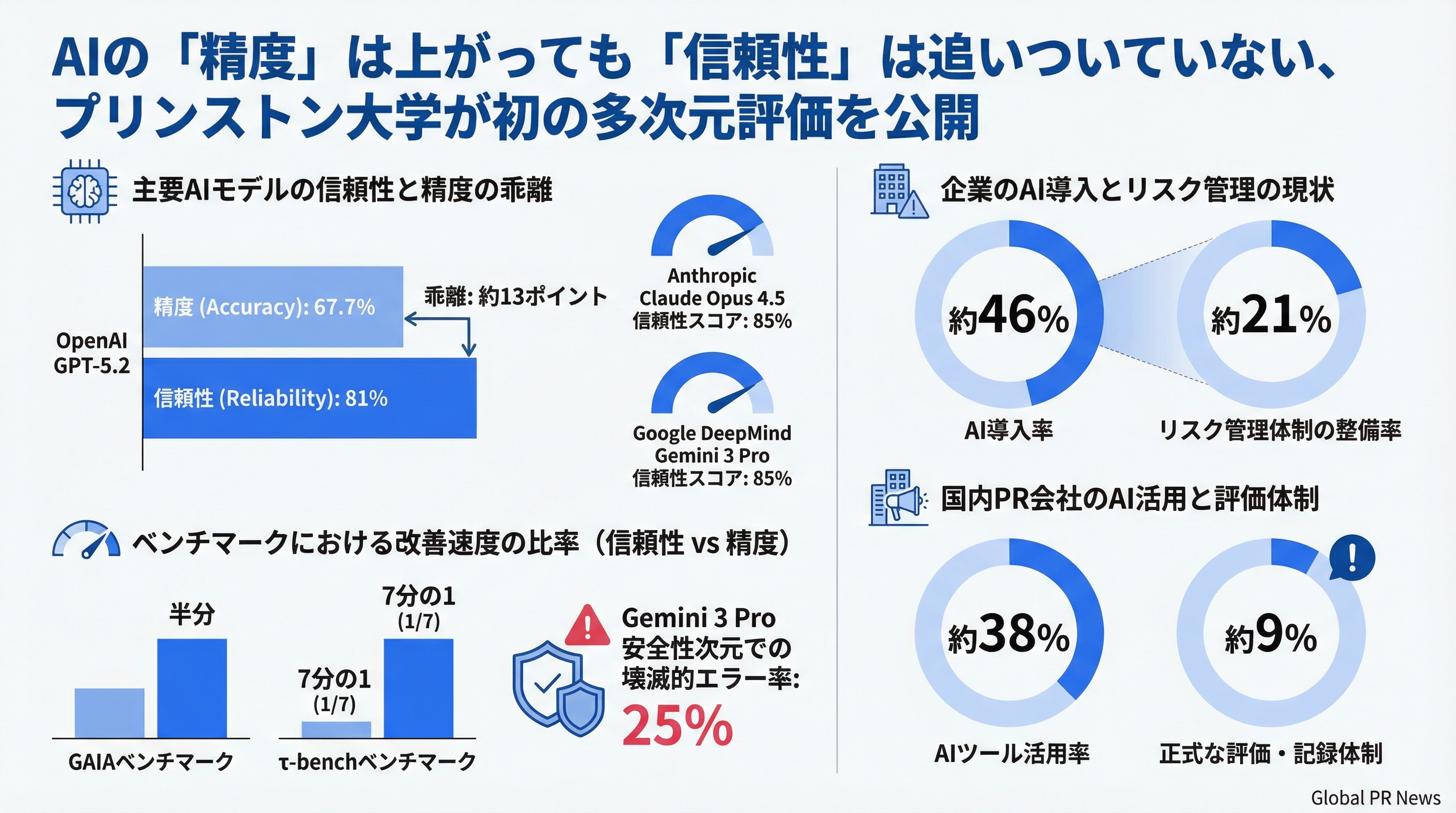

米経済誌Fortune(フォーチュン)は、AIエージェントの信頼性に関する大規模研究の結果を2026年3月24日公開の記事で報じた。米国プリンストン大学内の研究機関で、AIや情報技術が社会・政策に与える影響を実践的に分析することを専門とする「情報技術政策センター(CITP)」が発表した論文によると、現在市場に出回っている最先端AIエージェントは「精度」のスコアが高い一方で、「信頼性」の向上は精度の改善速度に大幅に遅れているという。

「精度」と「信頼性」の乖離が明らかに

この研究は、CITPのコンピュータ科学教授アービンド・ナラヤナン氏と研究者サヤシュ・カプール氏が主導し、2026年2月24日に論文として発表されたものだ。対象となったのは過去18ヶ月間にリリースされたフロンティアモデル14種で、OpenAI(GPTシリーズを開発する米国のAI企業で、ChatGPTの提供元として世界最大級のAIモデル市場シェアを持つ)、Anthropic(元OpenAI研究者が設立した米国のAIスタートアップで、安全性重視のAIモデル「Claude」シリーズを開発・提供している)、Google DeepMind(Googleの親会社Alphabetが運営するAI研究部門で、マルチモーダルAIモデル「Gemini」シリーズを開発している)という世界最前線の3社のモデルが横断的に検証された。

研究チームが今回初めて体系化したのは、一貫性・堅牢性・予測可能性・安全性という4つの次元にまたがる12〜14の新指標だという。従来のAI性能評価は各ベンダーが提示する「平均精度」に依存しており、同一タスクで回答がどれだけばらつくか、失敗した際にどれほど危険な挙動をとるかといったリスクは見えにくい構造になっていた。CITPはこの問題を「AIを普通のテクノロジーとして扱う」という実践的アプローチで解決しようとしているとしている。

数値を見ると、精度と信頼性の乖離は顕著だ。テスト対象の中で最も高い信頼性スコアを記録したのはAnthropicのClaude Opus 4.5とGoogle DeepMindのGemini 3 Proで、いずれも85%にとどまるという。OpenAIのGPT-5.2(同社が2025年後半にリリースした最新世代の大規模言語モデルで、AIエージェント用途に最適化されたバージョン)は精度が81%に対して信頼性が67.7%と、精度と信頼性の間に約13ポイントの乖離が存在することが報じられた。

「信頼性」は精度の7分の1の速さでしか改善しない

改善速度の格差はさらに深刻だという。汎用タスクの処理能力を評価する標準的なベンチマークデータセット「GAIA」では、信頼性の改善速度は精度の改善速度の半分にとどまるとしている。さらに、カスタマーサポート対話シナリオに特化した評価データセット「τ-bench(タウベンチ)」では、信頼性の改善速度が精度の改善速度の7分の1しかなかったという。つまり、チャット対応や問い合わせ処理といった実務に直結する場面で、AIは「正しい答えを出す能力」と「安定して正しく動き続ける能力」の間に大きな溝を抱えたまま普及が進んでいることになる。

加えて、トップスコアを記録したGemini 3 Proにおいても、安全性次元での「壊滅的エラー率」が25%に達することが報告された。4回に1回は深刻な誤動作を起こしうるという数字は、企業の公式窓口や広報業務にAIを組み込む際の重大なリスク要因となりうる。

第三者評価ダッシュボードを初公開

プリンストン大学はこの研究と合わせて、「HAL Reliability Dashboard」と呼ばれるオンラインの第三者評価ダッシュボードを公開した。このダッシュボードでは、各AIモデルの信頼性スコアを多次元で比較できるリーダーボード形式となっており、誰でも無償でアクセス可能だという。CITPは、AIベンダー各社が提示する自社ベンチマークに頼らず、独立した視点でモデルを評価する基盤を業界全体に提供することを目指しているとしている。

研究が指摘する背景には、AIエージェントの実運用が急拡大している現状がある。カスタマーサポート、情報収集、文書生成など、企業の広報・マーケティング業務でAIエージェントを活用する事例が急増する中、信頼性の低さは誤情報の拡散やブランド毀損リスクを実務レベルで高めると同論文は警告しているという。

情報ソース一覧

- AIを通常技術として捉えるブログ上の新論文:「AIエージェントの信頼性科学に向けて」 On the AI as Normal Technology Blog - New Paper: Towards a Science of AI Agent Reliability citp.princeton.edu

- AIエージェントの注目すべき能力は、深刻な信頼性問題を隠しているかもしれない | Fortune Your AI agent's headline-grabbing capabilities may mask a serious reliability issue | Fortune fortune.com

- AIエージェント信頼性科学:Princeton AI Agent Reliability Science: Princeton www.paperclipped.de/en/blog/ai-agent-reliability-science/

- HAL 信頼性評価 HAL Reliability Evaluation hal.cs.princeton.edu/reliability/

- AIエージェントの信頼性科学に向けて Towards a Science of AI Agent Reliability arxiv.org/html/2602.16666v1