倫理を貫いたAI企業が300億円の契約を失った教訓と日本の調達リスクの死角

AI Ethics vs. Government: US Startup Anthropic's Unprecedented Contract Loss

ポイント

- AI倫理を掲げる米Anthropic社が国防総省との2億ドル契約を失った

- 軍事AIの無制限使用要求を拒否し、政府から産業的破門に

- 契約を失った直後、ClaudeアプリがApp Storeで首位に急騰

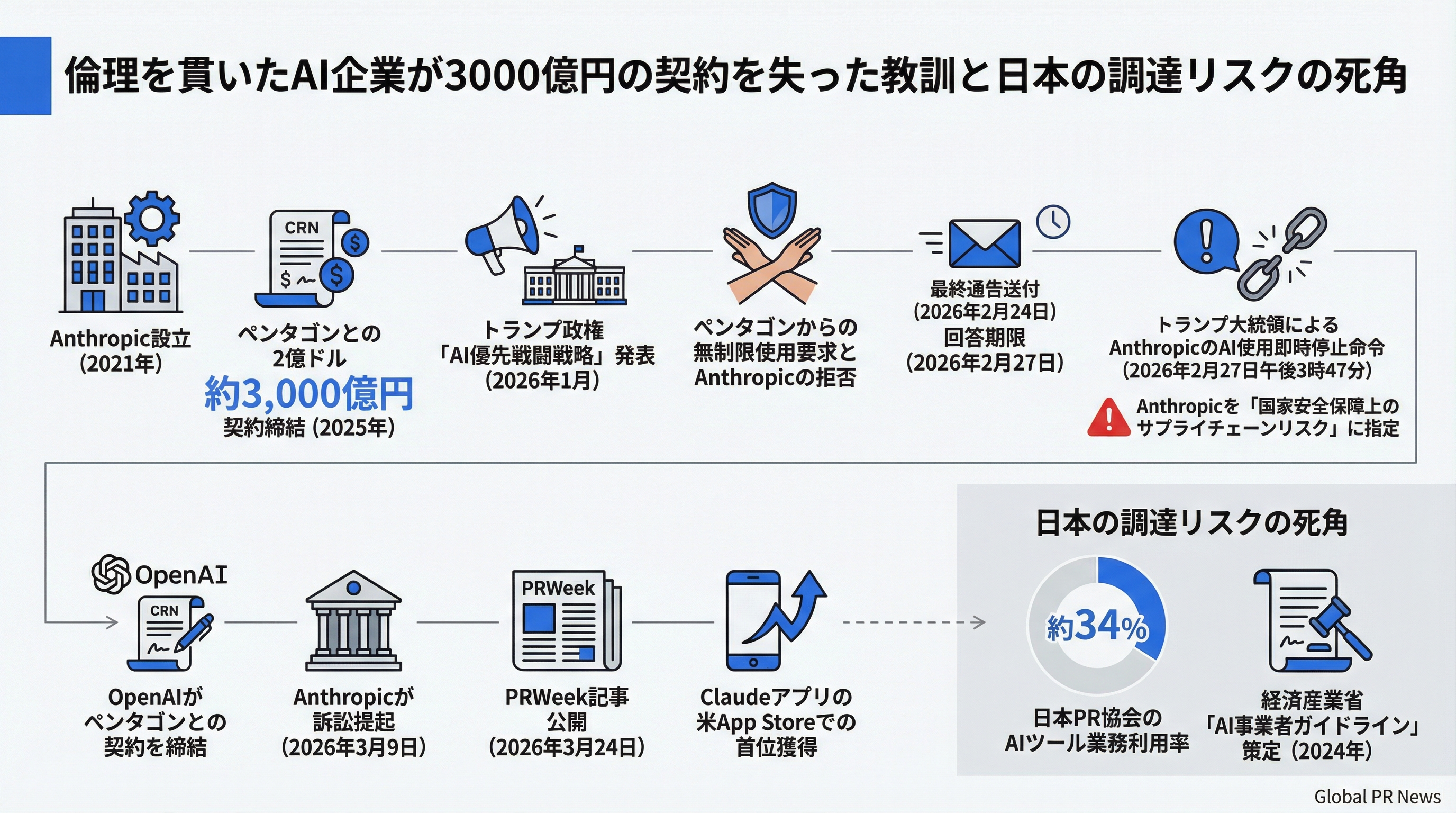

米国のPR業界専門誌「PRWeek」は、AIの安全性・倫理性を企業理念の核に据える米国AIスタートアップ、Anthropic(アンソロピック、本社サンフランシスコ、2021年設立)が米国防総省(ペンタゴン)との契約を失い、政府からの事実上の「産業的破門」に追い込まれた経緯の全容を2026年3月24日公開の記事で報じた。

2億ドル契約が突然白紙になるまで

Anthropicは、ChatGPT(チャットジーピーティー)を開発したOpenAI(オープンエーアイ)の元幹部、ダリオ・アモデイ氏らが設立したAI企業で、対話型AIアシスタント「Claude(クロード)」を提供している。ChatGPTの主要競合製品として知られるClaudeは、倫理的な制限を内蔵している点が最大の特徴だ。同社は2025年に2億ドル(約300億円 ※1ドル150円換算)規模のペンタゴンとの契約を締結し、機密ネットワーク上にClaudeを展開していたという。

問題が表面化したのは、トランプ政権の国防長官ピート・ヘグセス氏が2026年1月に「AI優先戦闘戦略」を発表したことがきっかけだという。同戦略は軍事AIの積極活用を最優先に掲げるもので、ペンタゴンはAnthropicに対し、大規模な国内監視や自律型致死兵器への「無制限使用」を要求したとされる。しかしAnthropicはこれを拒否した。

同誌によると、ペンタゴンは2026年2月24日付けで最終通告をAnthropicに送付し、回答期限を2月27日と定めたという。交渉は決裂し、トランプ大統領は2026年2月27日午後3時47分、自身が設立したソーシャルメディア「Truth Social(トゥルース・ソーシャル)」上で、連邦機関によるAnthropicのAI使用を即時停止するよう命令し、6ヶ月の移行期間を設けると投稿したと報じられている。

「法的根拠なし」と訴訟に発展

さらにヘグセス国防長官はAnthropicを「国家安全保障上のサプライチェーンリスク」に正式に指定し、軍事請負業者との商業取引をも禁止したという。この措置に対しAnthropicは2026年3月9日、「法的に根拠がない」として訴訟を提起したと報じられている。

一方で、Anthropicが政府市場から排除された直後、ChatGPTを擁するOpenAIがペンタゴンの機密システムへの展開契約を数時間以内に締結し、空席を埋めたという。PRWeekはこの一連の経緯を「企業が倫理的制限を維持したことによって政府契約を失った前例のない事例」と位置づけて報じた。

「追放」後にアプリが急騰した逆説

逆説的な事態も起きていると同誌は伝えている。政府によるAnthropicへの使用禁止が発表された後、一般消費者向けのClaudeアプリが米国のApp Storeで首位を獲得したという。これは、政府が「安全保障上のリスク」と名指しした企業を、一般市民が逆に支持するかたちで反応した現象だとしている。

この一連の経緯は、「AI倫理を守る企業が政府市場で不利になる」という構造的な問題を世界に示したと同誌は分析している。デジタル市民の自由・プライバシー保護を使命とする米国の非営利団体EFF(電子フロンティア財団)も、今回の対立について「プライバシー保護を少数の企業の判断に委ねるべきではない」との声明を出したと報じられている。

背景には、政府によるAI企業への圧力がもたらしうる「倫理的ダンピング競争」のリスクがある。倫理的制限を持たない競合が政府市場で優位に立てるなら、企業はコンプライアンスを下げることで市場を確保しようとするインセンティブが生まれる。今回の事件は、「企業の自主的な倫理方針に依存したAI安全保障」の脆弱性を世界規模で可視化したと指摘されている。

---

情報ソース一覧

- Anthropicと米国防総省の紛争のタイムライン A Timeline of the Anthropic-Pentagon Dispute techpolicy.press/a-timeline-of-the-anthropic-pentagon-dispute

- 危機のタイムライン: Anthropicの米国防総省への反発 | PR Week Timeline of a crisis: Anthropic’s Pentagon pushback | PR Week www.prweek.com

- Anthropicが米国政府を提訴した理由: 米国防総省とのAI戦争の裏にあるタイムライン Why Anthropic sued the US government: The timeline behind the AI war with the Pentagon www.storyboard18.com

- AnthropicのAIに関する米国防総省との協議がどのように展開したか: 完全なタイムライン How Anthropic’s AI Talks With the Pentagon Unfolded: Full Timeline www.techloy.com

- AnthropicとDODの紛争: プライバシー保護は少数の権力者の決定に依存すべきではない The Anthropic-DOD Conflict: Privacy Protections Shouldn’t Depend On the Decisions of a Few Powerful People www.eff.org

- 米国防総省とAnthropicの間で何が起こったのか? What happened between the Pentagon and Anthropic? www.readtangle.com/military-use-of-artifical-intelligence-anthropic-openai/

- Anthropic vs. 米国防総省: AI倫理が政府権力と衝突 | The Daily Economy Anthropic vs. The Pentagon: AI Ethics Collide With Government Power | The Daily Economy thedailyeconomy.org

- Anthropic vs. 米国防総省: どう決着したのか 😱 | AI権力闘争を解説 Anthropic vs The Pentagon: How It Ended 😱 | AI Power Struggle Explained www.youtube.com/watch